‘Deep fake’-ak. Adimen artifizialak nola sor ditzakeen gezurrezko albisteak

Galdera batekin hasten da guztia, Lola Flores espainiar kantariak egiten zuenaren modukoarekin 2021ean argitaratu zen bideo batean. Ustez, ordu arte agertu gabeko bideo bat zen. “Ba al dakizu niri zergatik ulertu zidaten mundu guztian? Azentuagatik”, esaten zuen artistak kamerari zuzen-zuzenean begiratzen ziola. Egiazko irudiak ziruditen, baina ez ziren; garagardo marka baten iragarkiaren zati bat zen, adimen artifizialak egin dezakeenaren adibide bikaina. Deepfake esaten zaion teknologiaren bidez sortu zuten. Adimen artifizialeko teknika horrek lehendik dauden irudiak erabiltzen ditu, eta ikaskuntza softwareen bidez eta GUN esaten zaien algoritmoen bidez (Generative Adversarial Network ingelesez eta Sare Antagoniko Sortzaileak euskaraz), aukera ematen du bideoak, irudiak eta ahots manipulatu eta gezurrezkoak sortzeko, baina itxuraz egiazkoak diruditenak. Eta hor dago arriskua.

Gezur baten jatorria

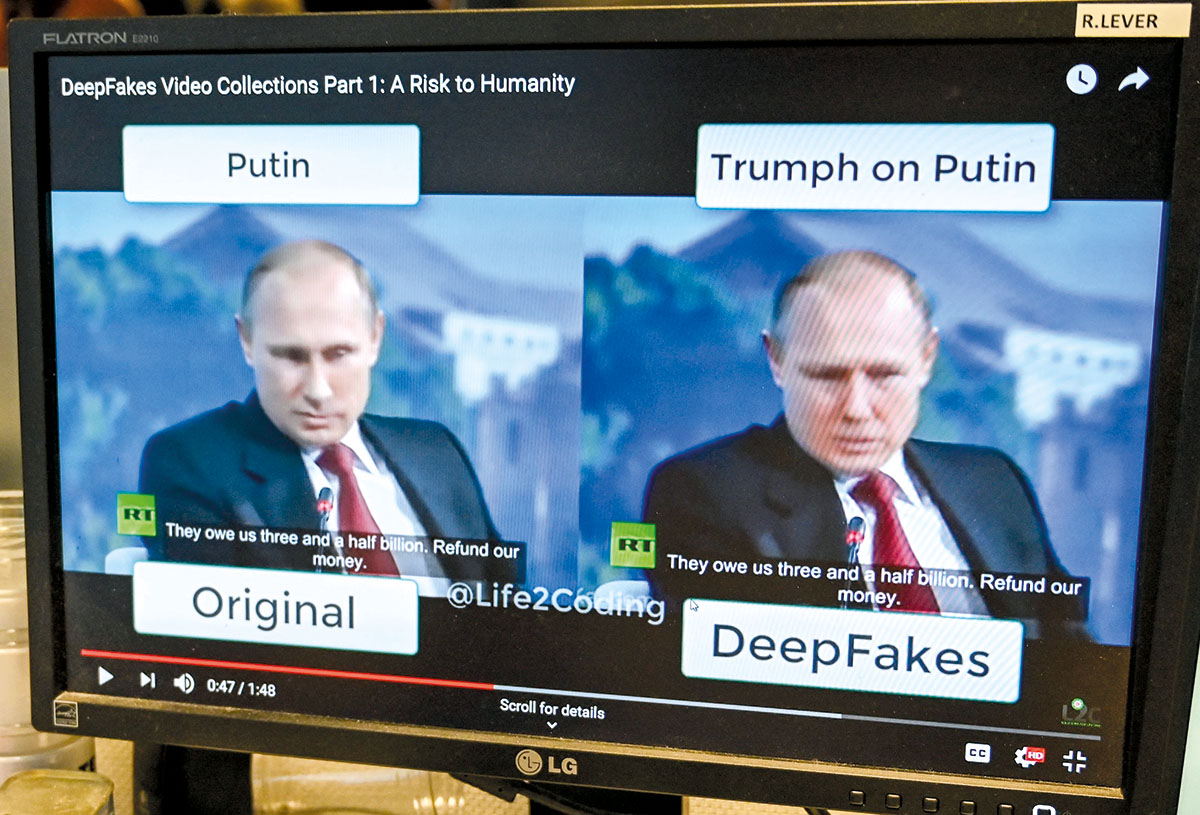

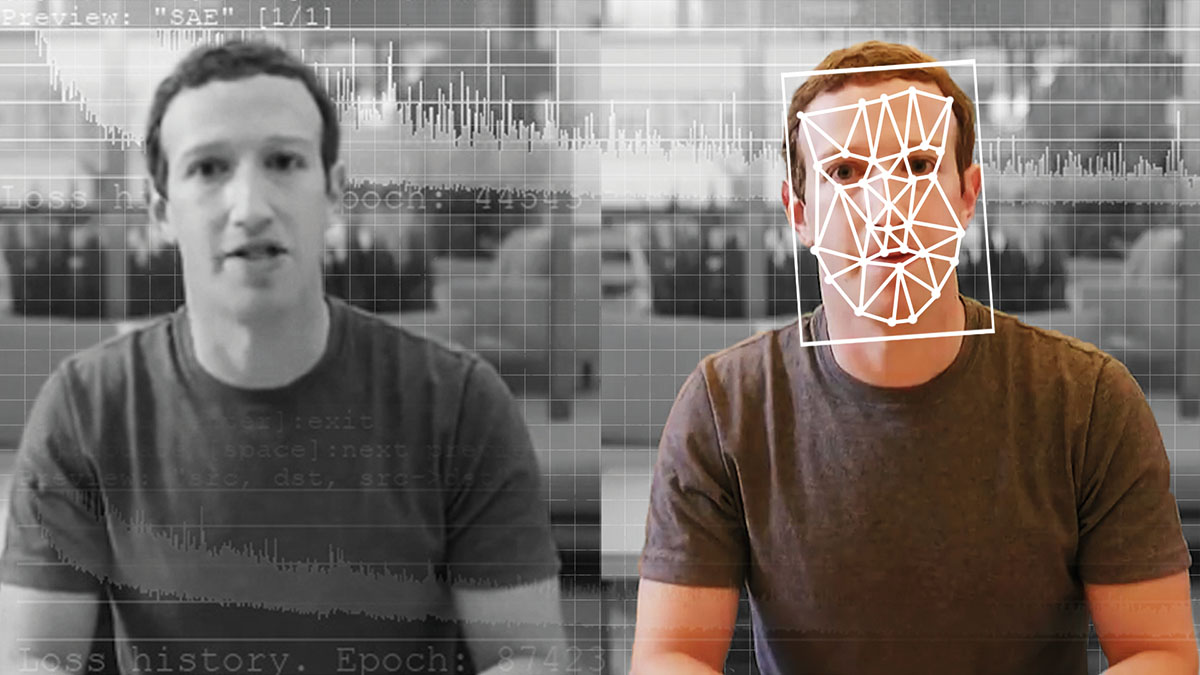

“Honela definitu ahalko genituzke Deepfakeak: artifizialki sorturiko edukiak dira, testu bidezkoak edo ikus-entzunezkoak, errealitatearekin bat ez datozenak. Gezurrezko albiste asmatuak izan daitezke edo bideoak, non pertsona baten aurpegia sartzen den sekula parte hartu ez duen eszena batean. Ohikoena izaten da politikaren munduan erabiltzea, baina gaur egun gezurrezko edukiek eta sinesgarritasun gutxikoek edo okerrek leku handia hartzen dute webguneetan eta sare sozialetan”, adierazi du David Losadak, zeina Konputazio Zientzietako eta Adimen Artifizialeko irakaslea den Santiago de Compostelako Unibertsitatean eta Teknologia Adimendunen Ikerkuntza Zentroko ikertzailea (CiTIUS). Maila bat baino gehiago dago Deepfake horien artean, baina hiru nabarmentzen dira: face-swap (aurpegia trukatzea), lip-sync (ezpainak sinkronizatzea audio mezu batekin) eta puppet master (txotxongilo birtuala). Adimen artifizialarekin manipulatu zituzten lehenbiziko bideoak laurogeita hamarreko urteetan agertu zirela dirudi, baina 2017an egin ziren ospetsu, Reddit albiste plataformaren hari batean helduentzako bideoak argitaratu zituztenean emakumezko aktore ospetsuen aurpegiekin.

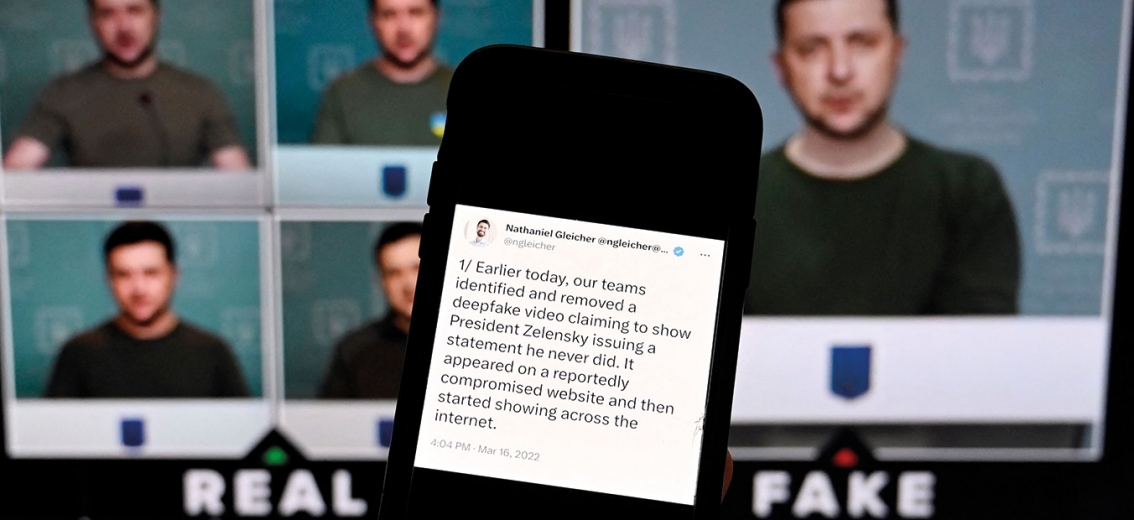

Ez zen hor bukatu kontua. Politikan kargu handiak dituzten pertsonen bideoak ere agertu izan dira sekula esan ez zituzten gauzak esaten, enpresaburu ospetsuak ere bai milioi askoko erosketak egingo dituztela aginduz… Horiek ongi erakusten dute Deepfake horiek gai direla desinformazioa hedatu eta liskar sozial, politiko eta ekonomikoa sortzeko, gezurrezko amarru horien biktimen intimitatea eta ohorea urratzeko edo adimen artifizialarekin bestelako delitu batzuk egiteko. 2022. urtearen bukaeran, pedofilo bat atxilotu zuten Valladoliden teknologia hori bera erabiltzen zuelako haurren kontrako sexu abusuen Deepfakeak sortzeko. 2023ko martxoan, Facebook eta Instagramen hainbat iragarki agertu ziren Deepfake FaceSwap aplikazioarenak, non emakumezko aktore ospetsuen aurpegiak erabiltzen zituzten amu gisa gezurrezko bideo pornografikoetan.

Nahiz eta zaila den ‘deepfake’ bati antza ematea, badira horretan laguntzen duten seinale batzuk:

- Akatsak. Askok akatsak izaten dituzte eta argi gelditzen da bideoa manipulatu egin dutela: ertz lausoak, larruazal artifizialki leuna, mugimendu zatikatuak edo argiztapen desberdintasunak izaten dira agerikoenak.

- Begi kliska. Deepfake batean egiazko bideoetan baino begi kliska gutxiago egiten dituzte pertsonek. Algoritmoa, izan ere, ez da gai begi kliskak egiteko iruzur zantzuak agerian utzi gabe, ez behintzat gizakiak bezain azkar egiteko.

- Lepoa eta aurpegia. Bideo horiek aurpegia bakarrik aldatzen dute, ez gorputz osoa, hori zailagoa da eta. Ageri den gorputzak eta aurpegiak ez badute bat egiten, beste arrasto bat izan daiteke bideoa gezurrezkoa dela jakiteko.

- Soinua. Irudiak askotan ez du behar bezala bat egiten ahotsarekin, eta ez da sinkronizaziorik izaten ezpainean eta soinuaren artean.

- Xehetasunak. Garrantzitsua da grabaketari buruzko informazio guztia eskuratzea eta, horretarako, lagungarria izan daiteke bideoa abiadura mantsoan ikustea. Deepfake bat baldin bada, bat-bateko aldaketak agertuko dira irudian edo aldaketak bideoaren hondoan.

- Ahoa. Adimen artifizialeko algoritmoak oraindik ez dira gai zehaztasunez kopiatzeko mihia, hortzak eta ahoaren barnealdea hitz egitean. Zati horretan nolabaiteko akatsen bat agertzeak erakutsiko digu bideo manipulatu baten aurrean gaudela.

- Jatorria. Artxiboa lehenik nork partekatu zuen jakitea eta zer-nolako sare sozialetan egin zuen jakitea lagungarria izan daiteke, baita zer-nolako testuinguruan argitaratu zen egiaztatzea eta jatorrizko xehetasunen berri izatea ere.

- Iraupena. Deepfake gehienak iraupen motzekoak izaten dira, segundo batzuetakoak. Bideoa oso motza denean eta eduki sinesgaitza duenean, zer pentsatua eman behar liguke.

Nola identifikatu?

Adituen gomendioa da zentzua eta pentsamendu kritikoa erabiltzea ohiz kanpoko edozein irudi edo bideo agertzen denean. Komunikabide tradizionalek badituzte egiaztatzaile taldeak irudi manipulatuak eta egiazkoak bereizteko —Ukrainako gerran berrikitan gertatu den bezala—, eta horien gomendioa da iturri ofizialetara jotzea, lehenago edo geroago gezurtatuko baitute informazio faltsua. Bideoa bada, ezaugarri jakin batzuetan jar dezakegu arreta, adibidez begi kliskak sinkronizatu gabe dauden, belarrien profilak lauso edo bikoiztuta, sudurra eta eskuak distortsionatuta, aurpegietan zehaztasuna galtzen den eta gainezartze bat dagoen 90 graduko angelu batean.

Aplikazio batzuek aukera ematen dute jende guztiak gisa horretako Deepfakeak sor ditzan adimen artifizialaren bidez informatikan adituak izan gabe, eta konpainia teknologiko handiak, berriz, aplikazioak lantzen ari dira desinformazioa azalarazteko, teknologiaren erabilera maltzurraren aurkako lasterketa batean sartuta. “Oraindik ez daukagu tresnarik edo softwarerik denbora errealean aztertuko dituenik era guztietako edukiak, euskarri eta plataforma mota guztietan, ikuslea gai izan dadin egiazko bideo bat eta gezurrezko bat bereizteko. Arlo hasiberria da eta mehatxu berriak agertzen dira egunero, nahiz eta badiren ikerkuntza proiektuak akademiaren eta enpresen eremuan arazo horren aurka egiteko, konpainia handiek dute-eta interes gehien kalitatezko informazioa eskura jartzeko. Tresna automatikoetako askok ikaskuntza gainbegiratua darabilte, eta egiazko Deepfake kasuez baliatzen dira sistemari erakusteko egiazkoa eta gezurrezkoa bereizten”, azaldu du Losadak. Ildo horretan ari dira lanean zenbait proiektu, adibidez Microsoft etxearen Video Authenticator delakoa, edo TREAD algoritmoa (Terrorism Reduction with Artificial Intelligence Deepfakes), zeina Brookings Institution-ek eta Northwestern Unibertsitateak (AEB) sortu duten, herrialdeetako zerbitzu militarrak eta inteligentziakoak prestatzeko Deepfake teknologia sortu eta ulertu dezaten. Edukiaren Jatorria eta Egiazkotasuna Babesteko Koalizioa da beste adibide bat, multinazional teknologikoek sustatu dutena desinformazioaren aurka egiteko eta estandar teknikoak lantzeko eduki digitalen jatorria egiazta dezaten.

- Aurpegia aldatzea. Face-swap

Jatorrizko aurpegiaren ordez beste bat jartzen da, egiazko pertsonaia batena edo fikziozko norbaitena; irudi finko bat sor daiteke, bideo bat edo zuzeneko emanaldi bat, Snapchat eta Face Swap Live aplikazio mugikorrak erabiliz esaterako.

Adimen Artifizialarekin edukiak sortzen ditu Metaphysic enpresak oso adibide onak lortu ditu; besteak beste, TikTok-en biral egin den kontu bat, @DeepTomCruise izenekoa, edo America’s Got Talent telebista programan lortu zuena, non teknologia hori erabiliz zuzenean elkartu zituzten parte-hartzaile baten aurpegia eta aurkezlearen gorputza. Horrekin batean, teknologia horri esker berpiztu egin zuten Elvis Presley, eta zuzeneko emanaldi batean agerrarazi zuten. - Ahots berri bat. Lip-sync

Lehendik egina zegoen bideo batetik abiatuta, audioa ordezkatu egiten da bestelako mezu bat emateko. Ezpainak sinkronizatzea izaten da gakoa.

Horren adibidea da BuzzFeed Video-k egin zuen esperimentu bisual bat, non Barack Obama AEBetako presidentea ageri zen bideo batean deepfakei buruzko ohartarazpen mezu bat emanez. Azken segundoetan erakutsi zuten lip-sync teknika nola erabili zuten eta zein zen mezua ahoskatzen ari zen aktorea. - Bi pertsonaren arteko fusioa. Puppet-master

Deepfake zailenetakoa da eta emaitza harrigarriak ematen dituena; oinarri gisa aktore baten gorputza erabiltzen da bideo berri bat sortzeko, eta beste pertsona baten irudia gainjartzen zaio, bien fusioa eginez. Horrekin batean, jatorrizko pertsonaiaren ahotsa berreskuratuko duen audio efektuak sartzen badira, are zailagoa izango da deepfakeari antza ematea.

Horren adibidea da Lola Flores-en irudiaz baliatuz garagardo marka batek egin duen iragarkia, non Lola Floresen antza zuen cantaora baten gorputza grabatu zuten oinarri gisa. Ondoren, artistaren artxiboko irudiak erabili behar izan zituzten, 5.000 baino gehiago, deeofakeari itxura emateko, postprodukzioko ehunka ordu eta doikuntza mordo bat sinesgarritasuna lortzeko, efektu bereziak ere bai eta haren alabaren ahotsa.

Errealitatea agerian jarriz

Ikerketa ildo horretan, proiektu aitzindari batean partaide da Espainia; CiTIUS erakundeak gidatzen du eta HYBRIDS du izena: Adimen hibridoa jardunbide demokratiko onak monitorizatzeko, sustatzeko eta aztertzeko. Hau da: gizakiak eta makinak elkarrekin borrokan desinformazioaren, gezurreko albisteen eta gorroto diskurtsoen aurka. Ekimen hori Europako Batasunak eta UK Research and Innovation erakundeak finantzatzen dute, eta analisi zientifikoa eskaintzen du desinformazioaren mehatxuei aurka egiteko. Nola lortuko duen? Tresna automatiko berriak sortuz, hizkuntza naturalaren (PLN) eta adimen artifizialaren prozesaketan oinarritzen direnak, eta horretarako, deep learning (ikaskuntza sakona) teknikez baliatuko dira. “Helburua da interpretazio neuro-sinbolikoa egiteko sistema berriak sortzea, ‘adimen hibridoa’ esaten diogun zerbait, zeinak konbinatu egiten dituen algoritmo neuronalen gaitasun konputazional handiak eta giza ezagutza, eta horrekin gainditu egin nahi dira adimen artifizialaren egungo metodoek dituzten gabeziak”, azaldu du Pablo Gamallok, zeina aditua den hizkuntzalaritza konputazionalean (HYBRIDS proiektuak Espainian duen arduraduna da).

Honela egiaztatzen da

Irudi bat manipulatua dagoela antzematea ez da erraza izaten beti, are gutxiago gaur egungo hartzaileek sare sozialak zein azkar kontsumitzen dituzten jakinda; pentsamendu kritikorik ez izateak ere ez du laguntzen, eta zailtasun teknikoak ere izaten dira gezurrezko edukiak eta egiazkoak bereizteko. Deepfake direlakoen zabalkundea izugarri ugaritzen ari da, eta Sensity txostenaren arabera (edukiak antzematea eta egiaztatzea da enpresa horren zeregina), 2018. urtetik hona bikoizten ari da sei hilabetetik behin.

“Deepfake kasu batzuk oso berriak dira, aski bisualak. Adibide bat izan litezke 2023ko otsailean Frantzian egin ziren manifestazioen irudiak, non istiluen aurkako poliziak agertzen diren manifestariei kontsolamendua ematen edo peluxezko hartz bat daramatela. Gertatu al zen halakorik? Ez. Adimen artifizialarekin sorturiko irudiak ziren guztiak, ukitu xalo batekin, baina zer gertatuko zatekeen besarkada bat ematen agertu beharrean ekintza bortitzak egiten agertu izango balira, istilu gehiago sortzeko pizgarri izaten direnak bezalakoak?”, galdetu du Miguel Hernandez Bozak, zeina segurtasun informatikoaren arloko aditua den, iruzurrean eta defentsako segurtasunean espezializatua.

Erretretaren erreformaren aurka Frantzian egin ziren manifestazioen irudiak gezurrezkoak zirela baieztatu zuen berehala Nina Lamparskik, AFP FastCheck plataformako zuzendari eta egiaztapenetan adituak. Zein izan zen arrasto erabakigarria? Belarri bikoitza ageri zuen aurpegi bat eta sei hatz zituzten eskuak. Adimen artifizialari oraindik ere kosta egiten zaio giza fisionomiaren alderdi batzuk diseinatzea, baina aztergai berria jarri die kazetariei eta informazio egiaztatzaileei, eta etorkizunean egiaztatu egin beharko dute ustez egiazko gisa iristen zaizkien irudi guztiak hala diren, gisa horretako akatsei erreparatuta. “DARPAk aurreratu du gehien ikerkuntzan, Ameriketako Estatu Batuetako Defentsako Ikerkuntza Proiektu Aurreratuen Agentziak. Duela urte batzuk aurreikusi zuten zein izango den gizarteak aurrez aurre izango duen arriskurik handiena: ahotsak, bideoak eta irudiak konbinatuz gezurrezko ekitaldiak sortzea. DARPAk egin duen lan horrek oinarri gisa balio lezake nazioartean desinformazioaren aurka ari diren proiektuetarako, ez daitezen hutsetik hasi. Haiek badute esperientzia eta hortik abiatu daiteke hobeto antzemateko, sistemak hobetzeko, analisi horiek ikus-entzunezko eduki guztietara zabaltzeko, maila globalean”, adierazi du Hernandez Bozak. Eta ohartarazi du hurrengo erronka ez dela izango gezurrezko bideo bat identifikatzea, bideo bat egiazkoa dela frogatzea baizik. “Gerta liteke legez kontrako ekintza bat egiten harrapatzea norbait eta hark ezetz esatea, Deepfake bat dela alegia, nahiz eta egiaz harrapatu izan. Horrek ere antzeko arazoak emango ditu. Bideoa egiazkoa dela frogatu beharko dugu, metadatuekin, iturri batekin baino gehiagorekin, ez dutela manipulatu jakiteko. Hortaz, zailtasuna ez da gezurrezko edukia antzematea bakarrik, baita egiazko edukiak baieztatzea ere: manipulatu gabe dagoela eta egiaz gertatu zela frogatzea”, azpimarratu du.

Adimen artifizialarekin zerikusia duten 1.000 enpresaburuk eta ikertzailek baino gehiagok –tartean Teslaren sortzaile Elon Musk-ek eta Apple-ren sortzaileetako batek, Steve Wozniak-ek– gutun ireki bat argitaratu zuten martxo bukaeran, eta gutxienez sei hilabeteko luzamendua eskatu zuten teknologia horren bilakaeran. Arrazoia: azken aurrerapenak dagoeneko gai dira gizakiekin lehiatzeko, eta enplegua desegiteko eta desinformazioa zabaltzeko erabil ahalko lituzkete. Garapen seguru bat eskatzen dute, eragin onuragarriak ekarriko dituena.

Europan lehenbiziko pausoak ematen ari dira teknologia mota horren etorkizun ezezaguna arautzeko, eta Adimen Artifizialaren Araudia lantzen ari dira horretarako (The AI Act). Oraindik eztabaida garaian dabiltza Europako Batasunean. Indarrean sartzen denean, Europan Adimen Artifizialarekin funtzionatzen duten sistema eta aplikazioak seguruak direla bermatzea izango da haren helburua eta oinarrizko eskubideak eta Batasuneko baliok errespetatzen dituztela; aldi berean, lege esparru uniforme bat eskainiko du, kide diren estatu guztiek beren araudietan sar ditzaten.

Espainia izan da lehen herrialdea Adimen Artifiziala Gainbegiratzeko Agentzia (AESIA) sortuko duela iragarri duena, eta haren eskumenak izango dira egiaztatzea eta zigorrak jartzea, eta zaindu egingo du Europako etorkizuneko araudia egoki beteko dela. Asmoa zen AESIA 2023ko udan has zedila lanean, A Coruñan ezarri dioten egoitzan, baina Juntos por Granada elkarte zibilak eta hiri horretako Udalak –egoitza hartzeko lehian sartua zegoen beste hiri batzuekin batean– helegitea jarri diote izendapenari eta mantsotu egin da abian jartzeko prozesua.

“Ikusteko dago zer-nolako eginkizunak izango dituen AESIAk eta nola ezarriko den Europako araudia. Espainian egin den apustuak lortu nahi du enpresek segurtasun protokolo batzuk eduki ditzatela, ikuskatzeko modukoak. AESIAk egiaztatze tresna bat sortu behar luke, kalitate zigilu baten antzekoa. Enpresa batek ziurtagiri hori lortzen badu, frogatu egin lezake ongi egiten ari direla eta herritarrek konfiantza eduki dezaketela produktu horretan. Egiaztatze erakunde batek, AESIAren babesarekin, ezagutza teknikoak dituzten langileak eduki beharko lituzke, eta horiek gai izan beharko lukete frogatzeko, gardentasunez, Adimen Artifizialean egiten ari den lana bat datorrela printripio etikoekin. Eta hala ez denean, zigorrak jarri, isunak edo zigilua kendu”, adierazi du Jose Maria Alonsok, Konputazio Zientzia eta Adimen Artifizialeko irakaslea bera Santiago de Compostelako Unibertsitatean eta CiTIUS-USC-eko ikertzailea.

Etorkizuneko AESIAn lan egingo duten profesionalek profil teknikoak eta juridikoak izango dituzte, teknologia berrietan eta segurtasun informatikoan espezializatuak.Jose Maria Alonsok, dena den, oroitarazi du profil horiei gehitu egin behar zaizkiela beste diziplina batzuetako profesionalak, adibidez hizkuntzalaritza, soziologia edo medikuntzakoak, beren ikuspegia eman dezaten Adimen Artifizialarekin egin daitezkeen erabileren eta abusuen inguruan. “Ez daiteke egin araudi bat ingeniarien eta abokatuen ezagutzan bakarrik oinarrituta. Eztabaida taldeak behar lirateke, non ikuspegi guztiak konbinatuko diren, diziplina anitzeko garapen inklusiboa izan dezan”, adierazi du.